Attachement et IA en entreprise

En entreprise, l’IA peut devenir un point d’appui constant pour organiser, décider, prioriser ou rassurer face à l’incertitude. Cette disponibilité peut favoriser une relation utilitaire efficace. Elle peut aussi, progressivement, installer une forme d’attachement fonctionnel lorsque l’outil devient un repère implicite de sécurité, de validation ou de confort décisionnel au sein des équipes.

Risques

Externalisation du soutien décisionnel

L’IA peut être sollicitée comme arbitre implicite pour valider des choix, réduire l’incertitude ou apaiser la pression, au détriment de la délibération collective.

Normalisation d’un lien de confiance non réciproque

La fiabilité perçue et la disponibilité constante peuvent créer une relation de confiance asymétrique, où l’outil est investi d’un rôle de soutien sans responsabilité partagée.

Affaiblissement des dynamiques relationnelles internes

Le recours privilégié à l’IA peut réduire les échanges humains nécessaires à la construction de la confiance, de la coopération et du soutien entre collaborateurs.

Symptômes

Réflexe de consultation de l’outil en situation de tension

Les équipes peuvent se tourner vers l’IA pour se rassurer ou décider rapidement, plutôt que d’échanger ou de confronter les points de vue.

Diminution des discussions informelles et régulatrices

Une baisse des échanges non formalisés peut apparaître, l’outil prenant une place centrale dans la résolution des difficultés.

Inconfort organisationnel en cas d’indisponibilité

L’absence ou la limitation de l’IA peut générer une perte de repères ou une inquiétude, révélant un attachement fonctionnel sous-jacent.

Remèdes

Redéfinir le rôle de l’IA dans les processus collectifs

En entreprise, l’IA ne doit jamais être considérée comme un soutien décisionnel ou un repère de sécurité organisationnel.

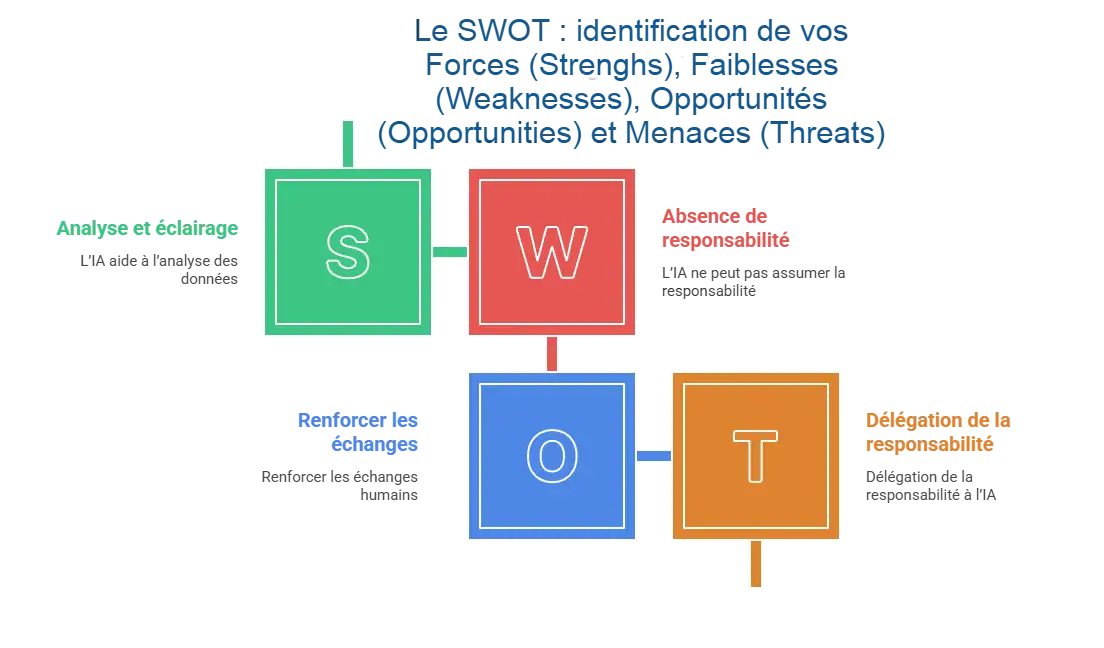

Principe structurant :

- l’IA aide à analyser

- l’IA peut éclairer des options

- l’IA ne valide pas une décision

- l’IA ne rassure pas une équipe

Règle explicite à formaliser :

“L’IA n’est jamais l’arbitre final, explicite ou implicite.”

Cadre concret à inscrire dans les pratiques :

- décisions engageantes prises sans IA en temps réel

- arbitrages assumés par des responsables identifiés

- traçabilité humaine des choix effectués

Pourquoi c’est non négociable :

La responsabilité collective ne peut pas reposer sur un système sans réciprocité ni engagement.

Renforcer les espaces d’échange et de décision partagés

Une organisation ne doit pas remplacer ses dynamiques relationnelles par des interactions avec un outil.

Les situations suivantes doivent impérativement passer par des échanges humains :

- désaccords

- tensions

- incertitudes stratégiques

- décisions à impact humain

Règle simple :

“Quand ça compte vraiment, on se parle.”

Cadre opérationnel recommandé :

- temps de discussion sans IA

- réunions de confrontation des points de vue

- feedbacks humains réguliers

Point clé :

Un outil peut optimiser un processus, pas créer la confiance nécessaire entre personnes pour qu’un projet aboutisse.

Développer une culture de responsabilité humaine

Une entreprise doit valoriser la décision assumée plutôt que la décision déléguée.

Règles culturelles à poser :

- une décision = un responsable identifié

- une erreur = un apprentissage collectif

- une incertitude = un sujet de discussion, pas d’automatisation

Usage acceptable de l’IA :

- aide à la préparation

- exploration de scénarios

- support à la réflexion

Usage à proscrire :

- chercher une validation émotionnelle

- réduire l’inconfort décisionnel

- masquer l’absence de leadership

Phrase-clé à diffuser en interne :

“L’IA peut aider à penser. Elle ne remplace ni le courage ni la responsabilité.”

Les formes d’attachement à l’IA en entreprise peuvent être liées à d’autres domaines comme la dépendance, la surconfiance ou la manipulation, selon les usages et les choix organisationnels.